L’intelligence artificielle progresse à grande vitesse, modifiant les processus métiers, les usages numériques et notre rapport à la technologie. Chaque année, de nouvelles avancées redéfinissent ce que l’on pensait possible, notamment en matière d’automatisation, de personnalisation ou d’assistance intelligente. Parmi les percées récentes les plus prometteuses, l’IA agentique occupe une place de choix. Encore peu connue du grand public, elle s’impose pourtant comme un tournant majeur dans la manière dont les systèmes numériques peuvent agir dans le monde réel.

Là où les IA classiques – génératives ou analytiques – se contentent d’exécuter des tâches spécifiques ou de produire du contenu, l’IA agentique vise une ambition bien plus grande : permettre à un système de poursuivre un objectif de manière autonome, en planifiant ses actions, en mobilisant les bons outils, en apprenant de ses erreurs, et en s’adaptant continuellement à son environnement. C’est l’introduction d’un véritable pouvoir d’action numérique – que l’on appelle « agentivité » – dans les systèmes intelligents.

Qu’est-ce que l’IA agentique ?

L’IA agentique désigne une nouvelle catégorie de systèmes d’intelligence artificielle capables de prendre des décisions de manière indépendante, de mener des actions ciblées, d’interagir avec des outils et des données variés, et d’apprendre en continu de leurs expériences. Ces « agents » ne sont pas de simples exécutants programmés, mais des entités logicielles qui sont capables d’adapter leur comportement en fonction du contexte, d’une manière proactive et raisonnée.

Le terme « agentique » est directement dérivé du mot « agent » au sens informatique, mais enrichi d’une capacité décisionnelle et contextuelle avancée. On parle ainsi d’agents capables d’autonomie, de raisonnement, de collaboration avec d’autres agents ou systèmes, et d’amélioration continue. Ce qui les distingue fondamentalement des assistants vocaux ou des chatbots, c’est leur faculté à sortir d’un cadre prédéfini pour proposer des solutions nouvelles à des problèmes complexes.

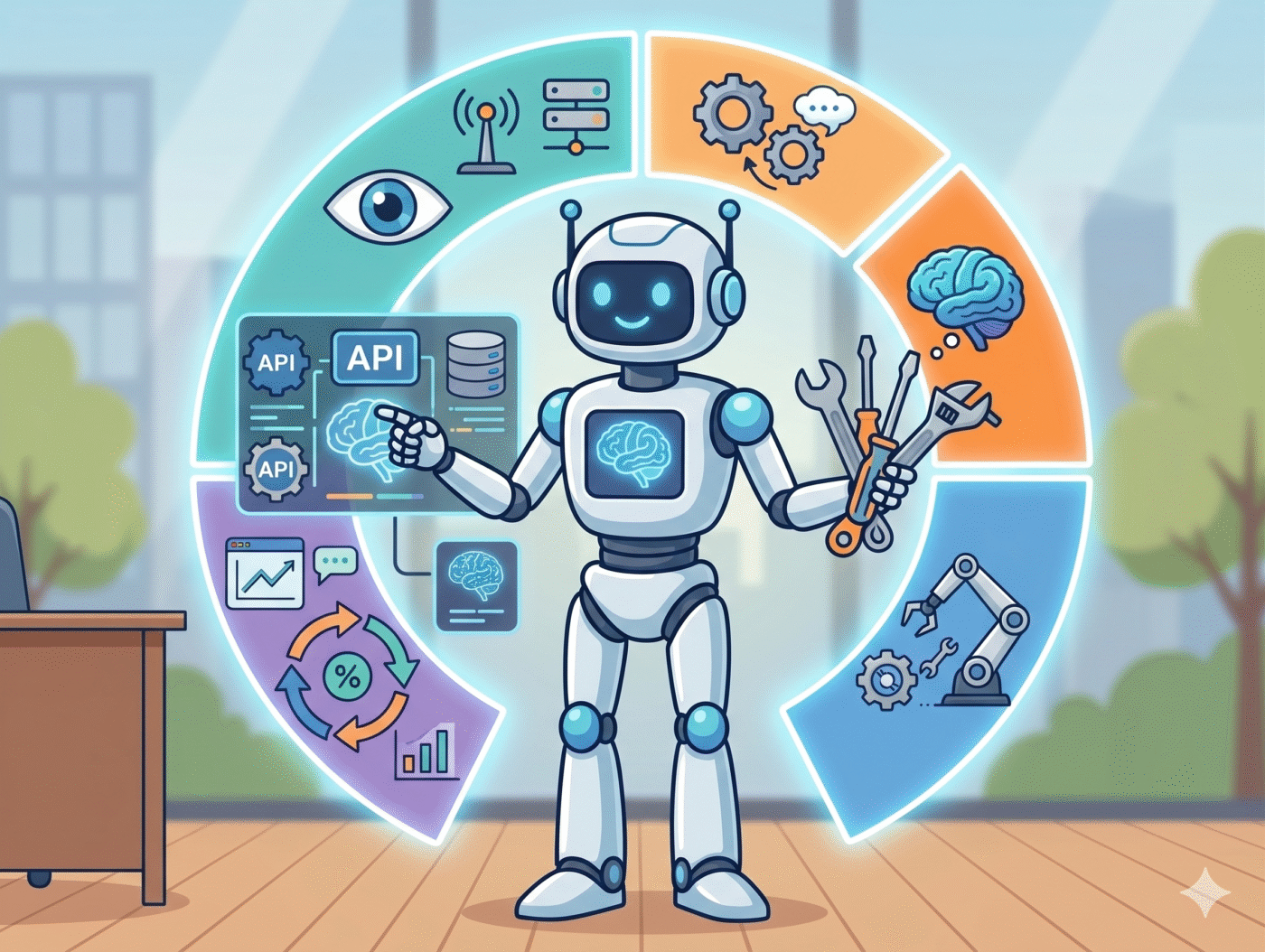

Ces capacités reposent sur une combinaison de technologies : les modèles de langage (LLM), le traitement automatique du langage naturel (NLP), la vision par ordinateur, l’apprentissage par renforcement, l’orchestration logicielle, ou encore l’interopérabilité avec des API externes. En les assemblant dans une architecture cohérente, on obtient un système capable d’identifier un objectif, de formuler une stratégie et de la mettre en œuvre – tout en s’ajustant au fur et à mesure des résultats.

Fonctionnement d’un système agentique

Le fonctionnement d’un agent d’IA agentique s’articule autour d’un cycle dynamique en plusieurs étapes : perception, raisonnement, planification, action, évaluation et apprentissage.

Cela commence par la perception : en effet, l’agent collecte des données issues de son environnement. Cela peut inclure des requêtes utilisateurs, des mesures de capteurs, des résultats d’API, des documents ou des historiques de conversations. À partir de ces données, il construit une représentation du contexte.

A partir de cela, il passe en phase de raisonnement. Le système va analyser les informations disponibles, identifier les intentions ou problèmes à résoudre, puis sélectionner une méthode adaptée. Il peut, par exemple, utiliser des heuristiques, des modèles statistiques ou des arbres de décision pour évaluer ses options. À ce stade, il est capable d’évaluer la probabilité de succès d’une action ou d’un plan.

La planification est l’étape suivante : l’agent élabore une séquence d’actions à accomplir. Il détermine les étapes nécessaires pour atteindre l’objectif, en tenant compte des contraintes de temps, de ressources ou de dépendances entre les tâches. Puis il passe à l’exécution, durant laquelle il agit dans le système ou l’environnement réel : en envoyant des requêtes, en déclenchant des scripts, en interagissant avec d’autres logiciels ou en produisant une réponse personnalisée.

Il est important de noter qu’après chaque action, l’agent procède à une phase d’évaluation. Il observe les effets de ce qu’il a fait, recueille des feedbacks (explicites ou implicites), détecte les erreurs éventuelles, puis ajuste son comportement pour les fois suivantes. Cette boucle d’apprentissage peut s’appuyer sur l’apprentissage par renforcement, des réseaux de mémoire à long terme ou des techniques de fine-tuning.

Enfin, dans les systèmes les plus évolués, plusieurs agents peuvent coopérer dans une architecture dite multi-agent. Chaque agent est spécialisé dans un domaine ou une tâche, et un agent coordonnateur (ou méta-agent) supervise l’ensemble, allouant les ressources, répartissant les missions, et consolidant les résultats. Cela permet de traiter des projets complexes de façon distribuée, modulaire et scalable.

Des bénéfices concrets pour les entreprises

L’introduction de l’IA agentique dans les organisations transforme la manière dont les entreprises automatisent leurs processus, interagissent avec leurs clients, prennent des décisions et conçoivent leurs produits ou services. L’un des bénéfices majeurs de cette technologie est sa flexibilité contextuelle : elle ne repose plus sur des scripts rigides, mais sur une intelligence opérationnelle capable d’interpréter la situation et d’agir en conséquence.

Dans le support client, par exemple, un agent peut traiter des requêtes complexes de bout en bout : comprendre une question formulée en langage naturel, retrouver les informations pertinentes dans des bases de données internes, engager une action (remboursement, activation, prise de rendez-vous), et répondre avec un message adapté au ton du client.

Dans le domaine du développement logiciel, des agents comme Devin de Cognition Labs sont capables de concevoir, tester, débuguer et documenter des programmes entiers à partir de simples instructions. En finance, ils analysent en temps réel les marchés, détectent des signaux faibles, ajustent les portefeuilles d’investissement ou automatisent les contrôles de conformité.

Dans les secteurs industriels et logistiques, ils assurent une supervision prédictive des chaînes de production, coordonnent les livraisons, anticipent les ruptures ou optimisent les niveaux de stock. En santé, ils accompagnent les praticiens dans la planification des soins, la gestion administrative ou la personnalisation des parcours patients. Même les ressources humaines bénéficient d’agents capables de filtrer des candidatures, planifier des entretiens ou guider les employés dans leur parcours.

Cette capacité d’automatisation intelligente, évolutive et contextuelle permet aux entreprises de gagner en productivité, de réduire les coûts, d’améliorer l’expérience utilisateur, et d’accélérer leur innovation. C’est un levier de transformation stratégique majeur, notamment pour les organisations confrontées à des défis d’échelle ou de complexité opérationnelle.

Une technologie prometteuse, mais à encadrer

Comme toute innovation technologique, l’IA agentique soulève des questions fondamentales en matière de gouvernance, de sécurité, d’éthique et de responsabilité. Le fait qu’un système puisse agir seul dans des environnements sensibles – comme la finance, la justice, la santé ou la sécurité – impose des garde-fous.

La transparence est une exigence clé : il doit être possible de retracer les décisions prises par un agent, de comprendre sur quelles données elles reposent, et de corriger les éventuelles erreurs ou biais. La supervision humaine reste indispensable, que ce soit en amont (pour définir les objectifs et les règles), en temps réel (pour intervenir si nécessaire), ou en aval (pour auditer les comportements du système).

L’IA agentique ne doit pas être confondue avec une intelligence artificielle générale (AGI) – encore hypothétique – ni être vue comme une entité douée de conscience. C’est un outil puissant, mais qui reste dépendant de son entraînement, de son paramétrage et des données qui l’alimentent. Si ces données sont biaisées, obsolètes ou mal étiquetées, le système peut adopter des comportements erronés ou indésirables.

Enfin, plus ces systèmes gagnent en autonomie, plus il devient crucial d’en assurer la gouvernance. Cela passe par la mise en place de normes, de certifications, de mécanismes de contrôle, et d’une culture de la responsabilité numérique partagée entre concepteurs, utilisateurs et régulateurs.